Seq2seq (Sequence to Sequence) Modell med PyTorch

Hva er NLP?

NLP eller Natural Language Processing er en av de populære grenene av kunstig intelligens som hjelper datamaskiner med å forstå, manipulere eller svare på et menneske på deres naturlige språk. NLP er motoren bak Google Translate som hjelper oss å forstå andre språk.

Hva er Seq2Seq?

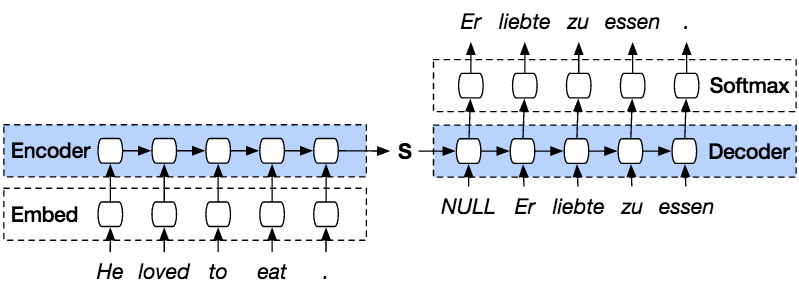

Seq2Seq er en metode for koder-dekoder basert maskinoversettelse og språkbehandling som kartlegger en inngang av sekvens til en utgang av sekvens med en kode og oppmerksomhetsverdi. Ideen er å bruke 2 RNN-er som vil fungere sammen med en spesiell token og prøve å forutsi neste tilstandssekvens fra forrige sekvens.

Hvordan forutsi sekvens fra forrige sekvens

Følgende er trinn for å forutsi sekvens fra forrige sekvens med PyTorch.

Trinn 1) Laste inn dataene våre

For vårt datasett vil du bruke et datasett fra Tabulatordelte tospråklige setningspar. Her vil jeg bruke datasettet fra engelsk til indonesisk. Du kan velge hva du vil, men husk å endre filnavnet og katalogen i koden.

from __future__ import unicode_literals, print_function, division

import torch

import torch.nn as nn

import torch.optim as optim

import torch.nn.functional as F

import numpy as np

import pandas as pd

import os

import re

import random

device = torch.device("cuda" if torch.cuda.is_available() else "cpu")

Trinn 2) Dataforberedelse

Du kan ikke bruke datasettet direkte. Du må dele setningene i ord og konvertere dem til One-Hot Vector. Hvert ord vil bli unikt indeksert i Lang-klassen for å lage en ordbok. Lang-klassen vil lagre hver setning og dele den ord for ord med addSentence. Lag deretter en ordbok ved å indeksere hvert ukjente ord for Sequence til sekvensmodeller.

SOS_token = 0

EOS_token = 1

MAX_LENGTH = 20

#initialize Lang Class

class Lang:

def __init__(self):

#initialize containers to hold the words and corresponding index

self.word2index = {}

self.word2count = {}

self.index2word = {0: "SOS", 1: "EOS"}

self.n_words = 2 # Count SOS and EOS

#split a sentence into words and add it to the container

def addSentence(self, sentence):

for word in sentence.split(' '):

self.addWord(word)

#If the word is not in the container, the word will be added to it,

#else, update the word counter

def addWord(self, word):

if word not in self.word2index:

self.word2index[word] = self.n_words

self.word2count[word] = 1

self.index2word[self.n_words] = word

self.n_words += 1

else:

self.word2count[word] += 1

Langklassen er en klasse som vil hjelpe oss å lage en ordbok. For hvert språk vil hver setning deles opp i ord og deretter legges til beholderen. Hver beholder vil lagre ordene i den aktuelle indeksen, telle ordet og legge til indeksen til ordet slik at vi kan bruke den til å finne indeksen til et ord eller finne et ord fra indeksen.

Fordi våre data er atskilt med TAB, må du bruke pandaer som vår datalaster. Pandas vil lese dataene våre som dataFrame og dele dem opp i kilde- og målsetningen vår. For hver setning du har,

- du vil normalisere det til små bokstaver,

- fjern alle ikke-tegn

- konvertere til ASCII fra Unicode

- del setningene, slik at du har hvert ord i den.

#Normalize every sentence

def normalize_sentence(df, lang):

sentence = df[lang].str.lower()

sentence = sentence.str.replace('[^A-Za-z\s]+', '')

sentence = sentence.str.normalize('NFD')

sentence = sentence.str.encode('ascii', errors='ignore').str.decode('utf-8')

return sentence

def read_sentence(df, lang1, lang2):

sentence1 = normalize_sentence(df, lang1)

sentence2 = normalize_sentence(df, lang2)

return sentence1, sentence2

def read_file(loc, lang1, lang2):

df = pd.read_csv(loc, delimiter='\t', header=None, names=[lang1, lang2])

return df

def process_data(lang1,lang2):

df = read_file('text/%s-%s.txt' % (lang1, lang2), lang1, lang2)

print("Read %s sentence pairs" % len(df))

sentence1, sentence2 = read_sentence(df, lang1, lang2)

source = Lang()

target = Lang()

pairs = []

for i in range(len(df)):

if len(sentence1[i].split(' ')) < MAX_LENGTH and len(sentence2[i].split(' ')) < MAX_LENGTH:

full = [sentence1[i], sentence2[i]]

source.addSentence(sentence1[i])

target.addSentence(sentence2[i])

pairs.append(full)

return source, target, pairs

En annen nyttig funksjon som du vil bruke er konverteringsparene til Tensor. Dette er veldig viktig fordi nettverket vårt kun leser tensortypedata. Det er også viktig fordi dette er den delen som i hver ende av setningen vil være et symbol for å fortelle nettverket at innspillingen er ferdig. For hvert ord i setningen vil den hente indeksen fra det aktuelle ordet i ordboken og legge til et symbol på slutten av setningen.

def indexesFromSentence(lang, sentence):

return [lang.word2index[word] for word in sentence.split(' ')]

def tensorFromSentence(lang, sentence):

indexes = indexesFromSentence(lang, sentence)

indexes.append(EOS_token)

return torch.tensor(indexes, dtype=torch.long, device=device).view(-1, 1)

def tensorsFromPair(input_lang, output_lang, pair):

input_tensor = tensorFromSentence(input_lang, pair[0])

target_tensor = tensorFromSentence(output_lang, pair[1])

return (input_tensor, target_tensor)

Seq2Seq-modell

PyTorch Seq2seq-modellen er en type modell som bruker PyTorch encoder-dekoder på toppen av modellen. Koderen vil kode setningen ord for ord til en indeksert av vokabular eller kjente ord med indeks, og dekoderen vil forutsi utgangen av den kodede inngangen ved å dekode inngangen i rekkefølge og vil prøve å bruke den siste inngangen som neste inngang hvis det er mulig. Med denne metoden er det også mulig å forutsi neste inngang for å lage en setning. Hver setning vil bli tildelt et symbol for å markere slutten på sekvensen. På slutten av prediksjonen vil det også være et symbol for å markere slutten på utgangen. Så fra koderen vil den sende en tilstand til dekoderen for å forutsi utgangen.

Koderen vil kode vår inndatasetning ord for ord i rekkefølge, og til slutt vil det være et symbol for å markere slutten på en setning. Koderen består av et Embedding-lag og et GRU-lag. Innebyggingslaget er en oppslagstabell som lagrer innebyggingen av våre input i en ordbok med fast størrelse. Det vil bli sendt til et GRU-lag. GRU-laget er en Gated Recurrent Unit som består av flere lags type RNN som vil beregne den sekvenserte inngangen. Dette laget vil beregne den skjulte tilstanden fra den forrige og oppdatere tilbakestillingen, oppdateringen og nye porter.

Dekoderen vil dekode inngangen fra koderutgangen. Den vil prøve å forutsi neste utgang og prøve å bruke den som neste inngang hvis det er mulig. Dekoderen består av et Embedding-lag, GRU-lag og et Lineært lag. Innebyggingslaget vil lage en oppslagstabell for utdata og sende det inn i et GRU-lag for å beregne den forutsagte utdatatilstanden. Etter det vil et lineært lag hjelpe til med å beregne aktiveringsfunksjonen for å bestemme den sanne verdien av den forutsagte utgangen.

class Encoder(nn.Module):

def __init__(self, input_dim, hidden_dim, embbed_dim, num_layers):

super(Encoder, self).__init__()

#set the encoder input dimesion , embbed dimesion, hidden dimesion, and number of layers

self.input_dim = input_dim

self.embbed_dim = embbed_dim

self.hidden_dim = hidden_dim

self.num_layers = num_layers

#initialize the embedding layer with input and embbed dimention

self.embedding = nn.Embedding(input_dim, self.embbed_dim)

#intialize the GRU to take the input dimetion of embbed, and output dimention of hidden and

#set the number of gru layers

self.gru = nn.GRU(self.embbed_dim, self.hidden_dim, num_layers=self.num_layers)

def forward(self, src):

embedded = self.embedding(src).view(1,1,-1)

outputs, hidden = self.gru(embedded)

return outputs, hidden

class Decoder(nn.Module):

def __init__(self, output_dim, hidden_dim, embbed_dim, num_layers):

super(Decoder, self).__init__()

#set the encoder output dimension, embed dimension, hidden dimension, and number of layers

self.embbed_dim = embbed_dim

self.hidden_dim = hidden_dim

self.output_dim = output_dim

self.num_layers = num_layers

# initialize every layer with the appropriate dimension. For the decoder layer, it will consist of an embedding, GRU, a Linear layer and a Log softmax activation function.

self.embedding = nn.Embedding(output_dim, self.embbed_dim)

self.gru = nn.GRU(self.embbed_dim, self.hidden_dim, num_layers=self.num_layers)

self.out = nn.Linear(self.hidden_dim, output_dim)

self.softmax = nn.LogSoftmax(dim=1)

def forward(self, input, hidden):

# reshape the input to (1, batch_size)

input = input.view(1, -1)

embedded = F.relu(self.embedding(input))

output, hidden = self.gru(embedded, hidden)

prediction = self.softmax(self.out(output[0]))

return prediction, hidden

class Seq2Seq(nn.Module):

def __init__(self, encoder, decoder, device, MAX_LENGTH=MAX_LENGTH):

super().__init__()

#initialize the encoder and decoder

self.encoder = encoder

self.decoder = decoder

self.device = device

def forward(self, source, target, teacher_forcing_ratio=0.5):

input_length = source.size(0) #get the input length (number of words in sentence)

batch_size = target.shape[1]

target_length = target.shape[0]

vocab_size = self.decoder.output_dim

#initialize a variable to hold the predicted outputs

outputs = torch.zeros(target_length, batch_size, vocab_size).to(self.device)

#encode every word in a sentence

for i in range(input_length):

encoder_output, encoder_hidden = self.encoder(source[i])

#use the encoder’s hidden layer as the decoder hidden

decoder_hidden = encoder_hidden.to(device)

#add a token before the first predicted word

decoder_input = torch.tensor([SOS_token], device=device) # SOS

#topk is used to get the top K value over a list

#predict the output word from the current target word. If we enable the teaching force, then the #next decoder input is the next word, else, use the decoder output highest value.

for t in range(target_length):

decoder_output, decoder_hidden = self.decoder(decoder_input, decoder_hidden)

outputs[t] = decoder_output

teacher_force = random.random() < teacher_forcing_ratio

topv, topi = decoder_output.topk(1)

input = (target[t] if teacher_force else topi)

if(teacher_force == False and input.item() == EOS_token):

break

return outputs

Trinn 3) Trening av modellen

Opplæringsprosessen i Seq2seq-modeller starter med å konvertere hvert par setninger til Tensorer fra deres Lang-indeks. Vår sekvens-til-sekvens-modell vil bruke SGD som optimizer og NLLLoss-funksjon for å beregne tapene. Treningsprosessen begynner med å mate paret av en setning til modellen for å forutsi riktig utgang. På hvert trinn vil resultatet fra modellen bli beregnet med de sanne ordene for å finne tapene og oppdatere parameterne. Så fordi du vil bruke 75000 75000 iterasjoner, vil vår sekvens-til-sekvens-modell generere tilfeldige XNUMX XNUMX par fra datasettet vårt.

teacher_forcing_ratio = 0.5

def clacModel(model, input_tensor, target_tensor, model_optimizer, criterion):

model_optimizer.zero_grad()

input_length = input_tensor.size(0)

loss = 0

epoch_loss = 0

# print(input_tensor.shape)

output = model(input_tensor, target_tensor)

num_iter = output.size(0)

print(num_iter)

#calculate the loss from a predicted sentence with the expected result

for ot in range(num_iter):

loss += criterion(output[ot], target_tensor[ot])

loss.backward()

model_optimizer.step()

epoch_loss = loss.item() / num_iter

return epoch_loss

def trainModel(model, source, target, pairs, num_iteration=20000):

model.train()

optimizer = optim.SGD(model.parameters(), lr=0.01)

criterion = nn.NLLLoss()

total_loss_iterations = 0

training_pairs = [tensorsFromPair(source, target, random.choice(pairs))

for i in range(num_iteration)]

for iter in range(1, num_iteration+1):

training_pair = training_pairs[iter - 1]

input_tensor = training_pair[0]

target_tensor = training_pair[1]

loss = clacModel(model, input_tensor, target_tensor, optimizer, criterion)

total_loss_iterations += loss

if iter % 5000 == 0:

avarage_loss= total_loss_iterations / 5000

total_loss_iterations = 0

print('%d %.4f' % (iter, avarage_loss))

torch.save(model.state_dict(), 'mytraining.pt')

return model

Trinn 4) Test modellen

Evalueringsprosessen til Seq2seq PyTorch er å sjekke modellutgangen. Hvert par av sekvens til sekvens-modeller vil bli matet inn i modellen og generere de forutsagte ordene. Etter det vil du se den høyeste verdien på hver utgang for å finne riktig indeks. Og til slutt vil du sammenligne for å se vår modellprediksjon med den sanne setningen

def evaluate(model, input_lang, output_lang, sentences, max_length=MAX_LENGTH):

with torch.no_grad():

input_tensor = tensorFromSentence(input_lang, sentences[0])

output_tensor = tensorFromSentence(output_lang, sentences[1])

decoded_words = []

output = model(input_tensor, output_tensor)

# print(output_tensor)

for ot in range(output.size(0)):

topv, topi = output[ot].topk(1)

# print(topi)

if topi[0].item() == EOS_token:

decoded_words.append('<EOS>')

break

else:

decoded_words.append(output_lang.index2word[topi[0].item()])

return decoded_words

def evaluateRandomly(model, source, target, pairs, n=10):

for i in range(n):

pair = random.choice(pairs)

print(‘source {}’.format(pair[0]))

print(‘target {}’.format(pair[1]))

output_words = evaluate(model, source, target, pair)

output_sentence = ' '.join(output_words)

print(‘predicted {}’.format(output_sentence))

La oss nå starte treningen med Seq to Seq, med antall iterasjoner på 75000 1 og antall RNN-lag på 512 med den skjulte størrelsen på XNUMX.

lang1 = 'eng'

lang2 = 'ind'

source, target, pairs = process_data(lang1, lang2)

randomize = random.choice(pairs)

print('random sentence {}'.format(randomize))

#print number of words

input_size = source.n_words

output_size = target.n_words

print('Input : {} Output : {}'.format(input_size, output_size))

embed_size = 256

hidden_size = 512

num_layers = 1

num_iteration = 100000

#create encoder-decoder model

encoder = Encoder(input_size, hidden_size, embed_size, num_layers)

decoder = Decoder(output_size, hidden_size, embed_size, num_layers)

model = Seq2Seq(encoder, decoder, device).to(device)

#print model

print(encoder)

print(decoder)

model = trainModel(model, source, target, pairs, num_iteration)

evaluateRandomly(model, source, target, pairs)

Som du kan se, samsvarer ikke vår forutsagte setning så godt, så for å få høyere nøyaktighet, må du trene med mye mer data og prøve å legge til flere iterasjoner og antall lag ved å bruke Sequence til sekvenslæring.

random sentence ['tom is finishing his work', 'tom sedang menyelesaikan pekerjaannya']

Input : 3551 Output : 4253

Encoder(

(embedding): Embedding(3551, 256)

(gru): GRU(256, 512)

)

Decoder(

(embedding): Embedding(4253, 256)

(gru): GRU(256, 512)

(out): Linear(in_features=512, out_features=4253, bias=True)

(softmax): LogSoftmax()

)

Seq2Seq(

(encoder): Encoder(

(embedding): Embedding(3551, 256)

(gru): GRU(256, 512)

)

(decoder): Decoder(

(embedding): Embedding(4253, 256)

(gru): GRU(256, 512)

(out): Linear(in_features=512, out_features=4253, bias=True)

(softmax): LogSoftmax()

)

)

5000 4.0906

10000 3.9129

15000 3.8171

20000 3.8369

25000 3.8199

30000 3.7957

35000 3.8037

40000 3.8098

45000 3.7530

50000 3.7119

55000 3.7263

60000 3.6933

65000 3.6840

70000 3.7058

75000 3.7044

> this is worth one million yen

= ini senilai satu juta yen

< tom sangat satu juta yen <EOS>

> she got good grades in english

= dia mendapatkan nilai bagus dalam bahasa inggris

< tom meminta nilai bagus dalam bahasa inggris <EOS>

> put in a little more sugar

= tambahkan sedikit gula

< tom tidak <EOS>

> are you a japanese student

= apakah kamu siswa dari jepang

< tom kamu memiliki yang jepang <EOS>

> i apologize for having to leave

= saya meminta maaf karena harus pergi

< tom tidak maaf karena harus pergi ke

> he isnt here is he

= dia tidak ada di sini kan

< tom tidak <EOS>

> speaking about trips have you ever been to kobe

= berbicara tentang wisata apa kau pernah ke kobe

< tom tidak <EOS>

> tom bought me roses

= tom membelikanku bunga mawar

< tom tidak bunga mawar <EOS>

> no one was more surprised than tom

= tidak ada seorangpun yang lebih terkejut dari tom

< tom ada orang yang lebih terkejut <EOS>

> i thought it was true

= aku kira itu benar adanya

< tom tidak <EOS>